🐊 논문 링크: https://arxiv.org/pdf/1708.05031.pdf

He, X., Liao, L., Zhang, H., Nie, L., Hu, X., & Chua, T. S. (2017, April). Neural collaborative filtering.

In Proceedings of the 26th international conference on world wide web (pp. 173-182).

1. INTRODUCTION

기존 추천시스템 연구는 Collaborative Filtering에 기반한 Matrix Factorization 관련 연구가 주류였다. 그러나 단순 inner-product는 explicit 데이터의 linear한 관계만을 표현한다는 한계가 있다. 딥러닝을 추천시스템에 적용한 연구들이 있었지만 implicit한 user interaction data의 복잡한 latent feature를 반영하기에는 한계가 있었다.

본 논문은 user-item 간의 implicit 정보를 활용하여 user preference를 더 잘 표현하고자 한다.

이를 위해 Matrix Factorization 기반 GMF 모델과 Neural Network 기반 MLP 모델을 결합한 NCF 프레임워크를 제안한다.

2. PRELIMINARIES

2.1 Learning from implicit data

추천 시스템에서 user와 Item의 관계는 Explicit / Implitcit한 데이터로 표현된다. Explicit data는 평점, 좋아요와 같이 고객이 아이템 대해 직접 선호도를 평가한 명시적 데이터이다. 반면 Implicit data는 시청 시간, 로그 기록과 같이 묵시적으로 나타나는 데이터이다.

본 논문에서는 user와 item간의 implicit data를 통해 latent feature를 학습하고자 한다. 이를 위해 평점 여부를 0 or 1로 표현한다.

2.2 Matrix Factorization

선행 연구로 MF에 관한 지식이 필요하다. 아래는 2009년에 발표된 Netflix Prize MF논문 링크이다.

- Matrix Factorization Techniques for Recommender Systems (2009)

- 논문 링크: https://datajobs.com/data-science-repo/Recommender-Systems-%5BNetflix%5D.pdf

3. NEURAL COLLABORATIVE FILTERING

논문에서 제시하는 new neural matrix factorization model은 MF와 MLP의 앙상블이다.

따라서 MF 의 linearity와 MLP의 non-linearity의 장점을 동시에 활용할 수 있다.

- 3.1 General Framework

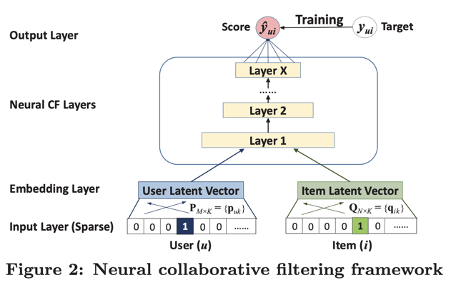

제안하는 프레임워크는 인풋으로 User와 item의 binary Identity 만을 one-hot encoding한 sparse vector로 활용한다. 각 input layer는 embedding layer를 통과하여 dense vector로 임베딩된다. 이후 본 논문에서 명명한 neural collaborative filtering layers를 지나 최종 prediction scores를 도출한다.

NCF에서 multi-layer-representation을 적용하기 위한 모델 그림은 위와 같다. 모델은 user-item interaction인 $y_{ui}$를 예측하기 위해 각 layer의 아웃풋이 다음 layer의 인풋으로 활용된다. User와 item은 원핫 인코딩 하여 인풋 데이터로 활용한다.

인풋 데이터는 임베딩 레이어와 fully connected 레이어를 거치게 된다. 각 neural CF layer는 특정한 latent structures를 발견하기 위해 커스터마이징 할 수 있다. NCF의 prediction model의 fomulation은 다음과 같다.

$$ \hat{y}_{ui} = f(P^T v^U_{u}, Q^T v^I_{i} |P, Q, \Theta_{f}) $$

$P \in \mathbb{R}^{M \times k}, Q \in \mathbb{R}^{N \times k}$ 는 각각 user와 item의 latent fator matrix를 의미한다. $\Theta_{f} $는 모델 파라미터이다.

$$ f(P^T v^U_{u}, Q^T v^I_{i}) = \phi_{out}(\phi_{X}(...{\phi_{2}(\phi_{1}(P^T v^U_{u}, Q^T v^I_{i}))...})) $$

$\phi_{out}, \phi_{x}$는 각각 output layer, x-th CF layer의 mapping function을 의미한다.

- 3.1.1 Learning NCF

모델이 학습하는 objective function은 아래와 같다. NCF는 아래 식을 최소화 하는 방향으로 학습을 진행하며 SGD 기법을 활용한다. 목적 함수는 binary cross-entropy log loss 식과 같으며 학습에는 네거티브 샘플링($y^-$)을 적용한 것을 알 수 있다.

$$ L = - \sum_{(u,i)\in y}{\log{\hat{y_{ui}}}} - \sum_{(u,j)\in y^-}{\log({1 - \hat{y_{ui}}}}) = - \sum_{(u,i)\in y\cup y^-}{y_{ui}\log{\hat{y_{ui}}}} + (1-y_{ui})\log(1-\hat{y_{ui}}) $$

- 3.2 Generalized Matrix Factorization (GMF)

본 논문에서 흥미롭게 읽은 부분이다. 저자들은 MF를 위 NCF 모델의 special case라고 말한다. User latent vector $p_{u}$를 $P^T v^U_{u}$로 표현하고 Item latent vector 역시 마찬가지로 표현한다. 따라서 first neural CF layer는 다음과 같다. 둘 간의 element-wise product를 진행한다.

$$ \phi_{1}({p_{u}, q_{i}}) = p_{u} \odot q_{i} $$

Output layer 식은 아래와 같다.

$$ \hat{y_{ui}} = a_{out}(h^T(p_{u} \odot q_{i}) $$

$ a_{out}$은 activation function, $h$는 weight를 의미한다. 이때 $a_{out}$으로 identity function, $h$를 uniform vector of 1이라면 위 식은 정확이 MF모델로 표현된다. 본 연구에서는 activation으로 sigmoid를 사용하여 non_linear한 표현이 가능하게 했다. 이 부분을 GMF라고 명명하고 있다.

- 3.3 Multi-Layer Perceptron (MLP)

MLP는 user와 item feature를 two path로 concatenation한다. 그러나 단순 concat은 latent feature의 interaction을 충분히 반영하지 못하기 때문에 여러 hidden layer를 통해 모델에 높은 유연성과 비선형성을 부여한다. 아래 식과 같이 MLP는 layer 수만큼 activation 함수를 통과시킨다. 식에서 $W_{x}$는 가중치 매트릭스, $b_{x}$는 bias, $a_{x}$는 활성 함수를 뜻하고 ReLU를 사용하였다. 식은 일반적인 딥러닝의 MLP구조와 같다.

$$ z_{1} = \phi(p_{u}, q_{i}) = \begin{bmatrix}p_{u} \\ q_{i} \end{bmatrix} $$

$$ \phi_{L}(z_{L-1}) = a_{L}(W^T_{L}z_{L-1} + b_{2}) $$

$$ \hat{y_{ui}} = \sigma (h^T\phi_{L}(z_{L-1})) $$

- 3.4 Fusion of GMF and MLP

최종적으로 제안하는 NeuMF 모델이다. 앞서 언급한 것과 같이 GMF와 MLP를 합친 모델이다. 이러한 앙상블 모델을 통해 linearity와 non-linearity의 장점을 동시에 활용할 수 있다. 본 연구에서는 input 데이터로 user와 item 원 핫 인코딩 벡터를 임베딩 layer에 통과시킨 후 사용한다. 이 때 두 모델이 같은 embedding layer를 share할 수도 있지만, 두 장점을 동시에 고려하기 위해 임베딩 역시 각각 진행한다. 아래는 최종 모델의 구조와 식이다.

User와 Item 원핫 인코딩 벡터를 GMF, MLP 각각 임베딩을 시킨 후 각각 Layer들을 통과하며 학습을 진행한다. 이후 최종적으로 두 벡터를 concat한 후에 NeuMF Layer를 통과하여 최종 $\hat{y_{ui}}$를 예측하고 Log loss function을 통해 Training을 진행한다. 이때 효율적인 학습을 위해 (Local minimum에 빠지지 않기 위해) GMF, MLP 각각 pre-trained으로 학습된 두 벡터를 concat하여 NeuMF Layer를 학습한다. pretraining은 Adam, NeuMF는 SGD 옵티마이저를 사용한다.

$$\phi^{GMF} = p^G_{u} \odot q^G_{i},$$

$$\phi^{MLP} = a_{L}(W^T_{L}(a_{L-1}(...a_2(W^T_2 \begin{bmatrix}p^M_u \\q^M_i \end{bmatrix} + b_2)...))+b_L),$$

$$\hat{y_{ui}} = \sigma(h^T\begin{bmatrix}\phi^{GMF} \\\phi^{MLP} \end{bmatrix}),$$

- $p^G_{u}$: User embedding for GMF

- $p^M_{u}$: User embedding for MLP

- $q^G_{i}$: Item embedding for GMF

- $q^M_{i}$: Item embedding for MLP

4. EXPERIMENTS

논문에서 해결하고자 하는 research question은 아래와 같다.

- RQ1. Do our proposed NCF methods outperform the state-of-the-art implicit collaborative ltering methods?

- RQ2. How does our proposed optimization framework (log loss with negative sampling) work for the recommen dation task?

- RQ3. Are deeper layers of hidden units helpful for learning from user{item interaction data?

- 데이터 셋은 무비렌즈 데이터와 핀터레스트 데이터를 사용한다.

실험을 통해 3가지 RQ들을 해결하였고, 성능 역시 SOTA를 달성했다. 실험 결과와 결론은 생략하겠다.

Review

기존 MF기반의 추천시스템을 개선하여 딥러닝을 적용한 프레임 워크를 제시한 논문이다. non-linearity와 linearity를 앙상블을 활용하여 동시에 학습하는 점이 흥미로웠다. 딥러닝 추천시스템 분야에서 뼈대가 되는 논문이고, 추후에 NCF 구조를 개선한 소논문도 써보면 좋겠다는 생각을 했다. 논문에서는 유저, 아이템의 아이덴티티 벡터만을 인풋으로 사용했지만, 이를 개선하여 더 많은 정보를 임베딩 할 수 있을 것 같다. 이후에는 NCF 코드를 포스팅할 예정이다.